Sono diplomato in Informatica presso l’Istituto Giua di Cagliari (voto 91/100). In università seguo il corso di laurea in Ingegneria Elettronica, Informatica e delle Telecomunicazioni (UniCa), indirizzo Informatica — non mi presento come “programmatore a progetto” fine a sé stesso, ma come persona che capisce tecnologia, contesto e persone e può dare una mano su più fronti.

Mi interessano lo sviluppo web e mobile, l’intelligenza artificiale applicata in modo concreto e la cybersecurity. Credo in innovazione, lavoro di squadra e nel fatto che la tecnica serva a risolvere problemi veri, non a impressionare.

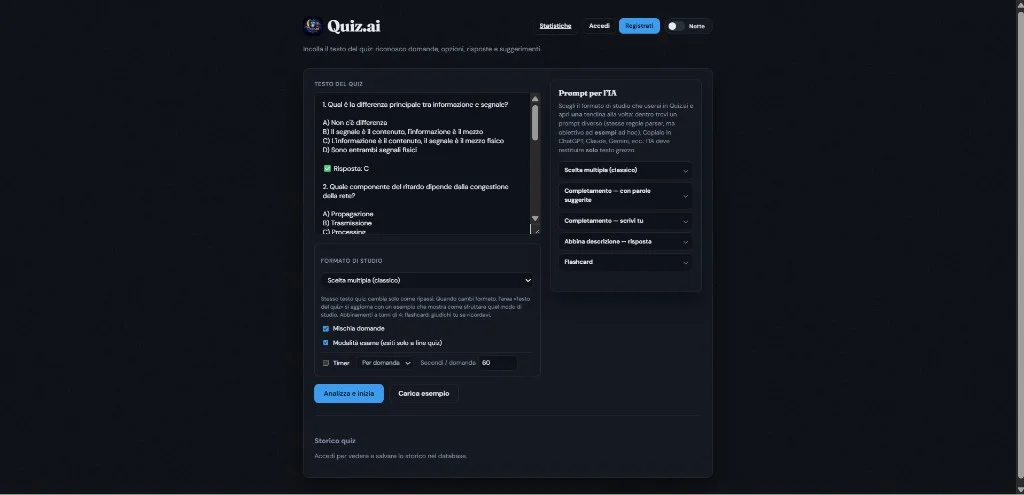

Conosco a fondo i modelli di linguaggio (LLM) nel loro spettro: architetture e famiglie (es. modelli puramente autoregressivi, encoder/decoder, specializzazioni), come vengono addestrati (pretraining su grandi corpora, *instruction tuning* / SFT, allineamento con tecniche da RL a preferenza), e la storia e l’evoluzione (da rappresentazioni classiche e reti profonde al paradigma *Transformer* e al boom attuale). In progetti uso spesso le API in cloud o stack veloci (es. Gemini, Groq), ma il ragionamento non si limita a un singolo fornitore.

Cosa mi piace fare — e dove sono più utile

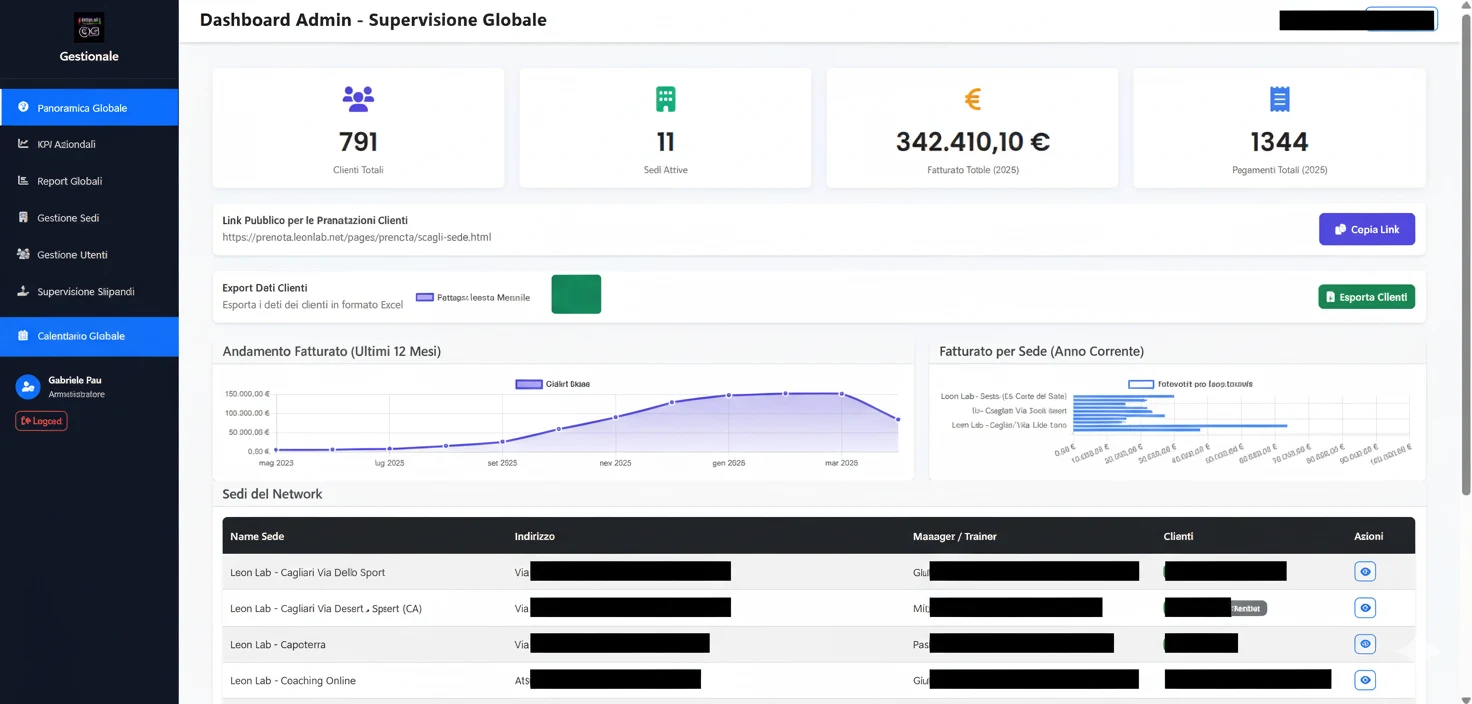

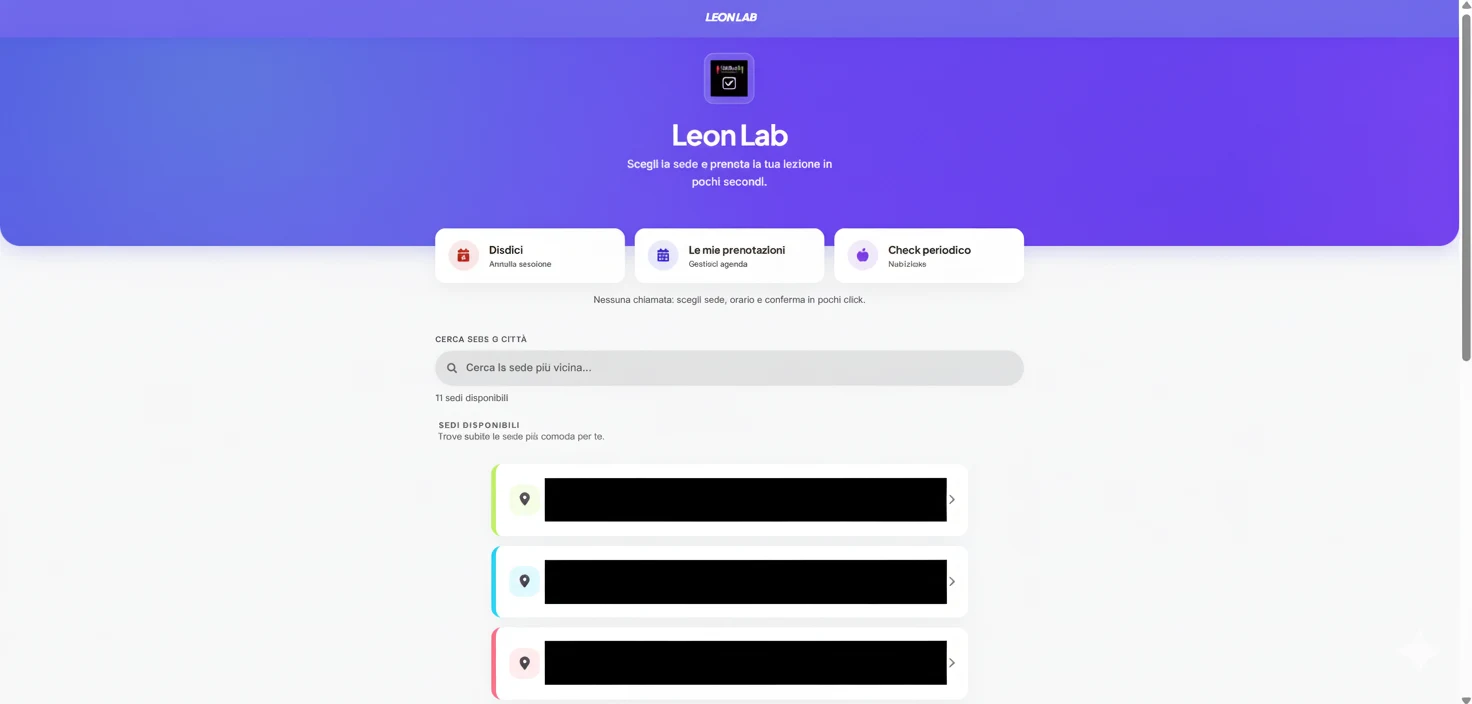

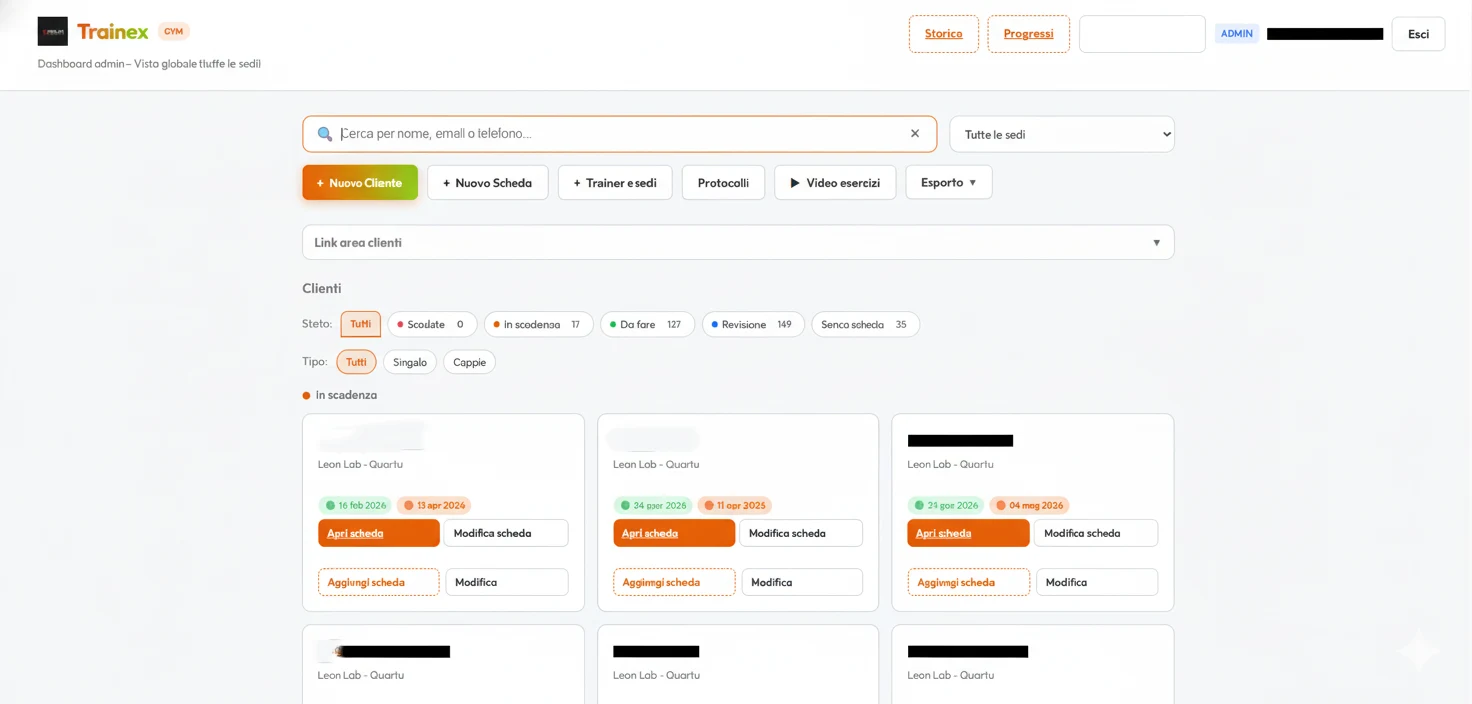

- Prodotto digitale end-to-end: architettura, UI, API, dati

- LLM e AI generativa oltre i singoli brand: ecosistemi aperti e proprietari, scelta di modelli, prompt e integrazioni; in produzione (es. Gemini, Groq) o dove serve *self-hosted* o stack scientifico / prototipi

- Mobile (React Native) e web moderno (React, ecc.)

- Sicurezza di base e buone pratiche: non solo “funziona”

- Comunicare con team non tecnici: tradurre il caos in priorità

Lettura & materiali

Libri e risorse che mi hanno formato (lista sempre in aggiornamento):

- Manuali e risorse su architettura software, reti e sicurezza (Cisco, laboratori)

- Documentazione e best practice su React, Supabase, mobile

- Fondamentali e survey su NLP, Transformer e LLM: pretraining, *fine-tuning* / SFT, allineamento (RLHF, DPO e simili) e tracciato storico da modelli classici a *large language models*

- Paper, note tecniche e prodotti: API, *prompt engineering*, valutazione e impiego responsabile oltre la demo